今回はニューラルネットワークで重みを調整する手法に関する内容となります。

誤差伝播法(Backpropagation)

誤差伝播法(バックプロパゲーション) は、ニューラルネットワークの学習において、誤差を各層の重みへと伝播させ、最適なパラメータを求めるための手法です。

(1)誤差伝播法の基本的な流れ

1. 順伝播(Forward Propagation)

入力データを受け取り、各層のニューロンを通じて出力を計算する。

2. 誤差計算(Loss Calculation)

出力と正解ラベルの誤差を損失関数を使って計算する。

3.誤差の逆伝播(Backward Propagation)

誤差を出力層から入力層へと逆向きに伝え、各パラメータ(重み・バイアス)の勾配を求める。

4.パラメータの更新(Weight Update)

勾配降下法(SGDなど)を用いて、重みを更新する。

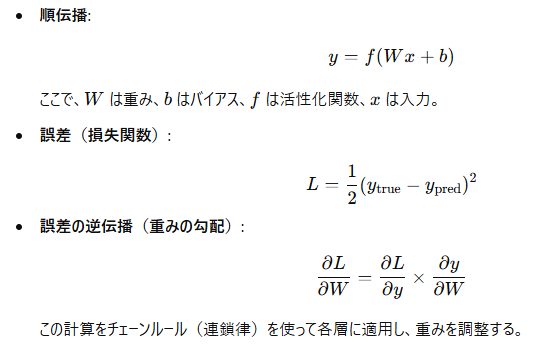

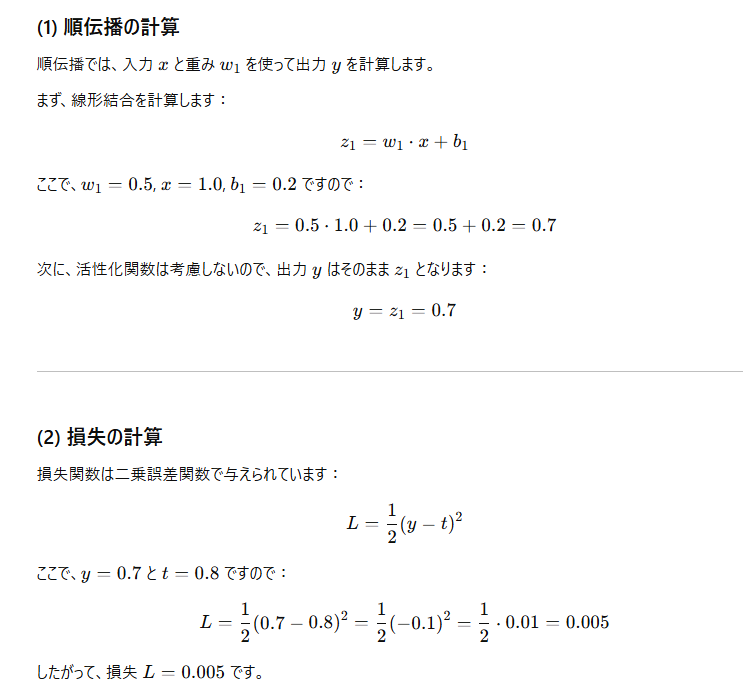

(2)誤差伝播法の数式(簡単な例)

深層学習(Deep Learning)

(1)深層学習とは?

深層学習(ディープラーニング) は、多層のニューラルネットワークを用いた機械学習手法のこと。通常、隠れ層が3層以上のニューラルネットワークを指す。

(2)深層学習の主な構造

入力層(Input Layer)

データの特徴(ピクセル値、数値データなど)を受け取る。

隠れ層(Hidden Layer)

活性化関数を適用し、特徴を抽出・変換する。

出力層(Output Layer)

最終的な予測を出力する。分類ならSoftmax、回帰なら線形出力を用いる。

誤差伝播法と深層学習の関係

- 誤差伝播法は、深層学習における学習の基盤

- 隠れ層が多くなると、勾配消失問題(Vanishing Gradient) が発生し、学習が進みにくくなる

- 対策として、ReLUなどの活性化関数やBatch Normalization、最適化手法(Adamなど)が導入された

まとめ

- 誤差伝播法 は、誤差を各層に逆伝播させて学習を行う手法

- 深層学習 は、複数の隠れ層を持つニューラルネットワークを使う学習手法

- 誤差伝播法を用いることで、深層ニューラルネットワークのパラメータが最適化される

演習

問1. 誤差伝播法(Backpropagation)の主な目的は何か?

- 出力層の値を増やす

- 損失関数の勾配を計算し、重みを更新する

- データを前処理する

- 学習データの数を増やす

問2. ニューラルネットワークの学習で、誤差伝播法が計算するのはどれか?

- 重みの初期値

- 活性化関数の種類

- 損失関数の勾配

- 出力の確率分布

問3. 深層学習で層を増やす主なメリットは何か?

- 計算コストを削減できる

- 特徴を自動的に抽出し、より複雑なパターンを学習できる

- モデルの学習時間を短縮できる

- 勾配消失問題を回避できる

問4. 誤差伝播法を使う際に、勾配消失問題が起こりやすいのはどの活性化関数か?

- ReLU

- シグモイド

- ソフトマックス

- Leaky ReLU

問5. ニューラルネットワークの重みを更新する際、使用する最適化アルゴリズムとして 誤差伝播法とともに用いられる のはどれか?

- K-Means

- 遺伝的アルゴリズム

- 確率的勾配降下法(SGD)

- 主成分分析(PCA)

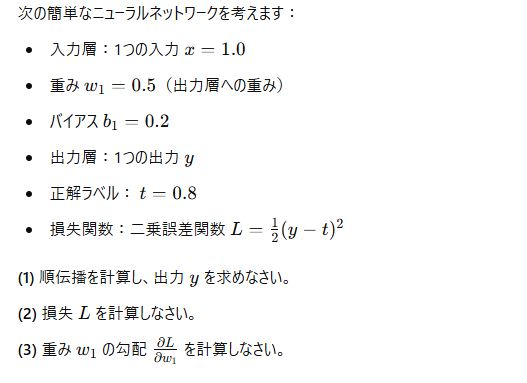

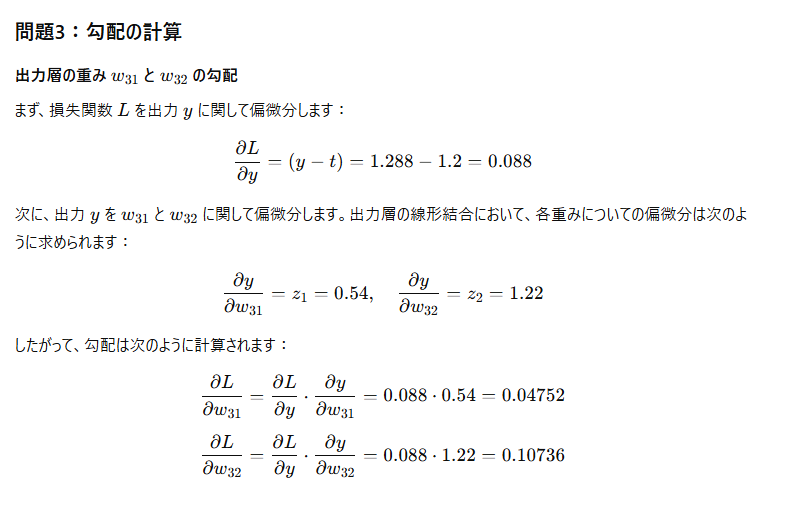

問6.

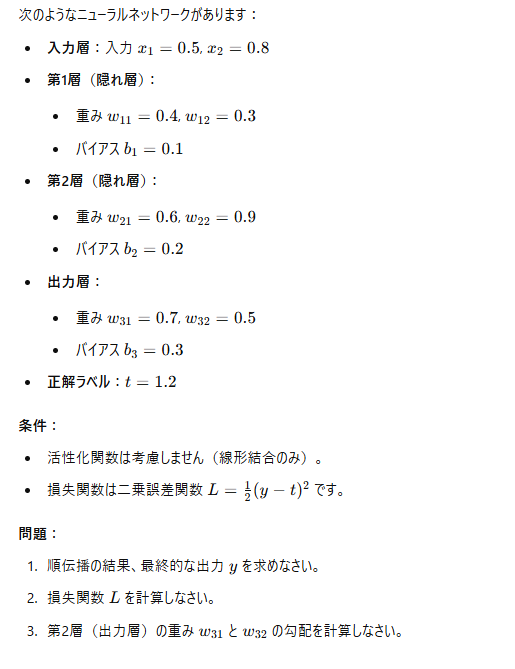

問7.

↓

↓

↓

(解答)

問1. 誤差伝播法(Backpropagation)の主な目的は何か?

答え: 2. 損失関数の勾配を計算し、重みを更新する

解説:

誤差伝播法はニューラルネットワークの学習アルゴリズムで、目的はネットワークの出力と実際の出力との誤差(損失)を最小化することです。具体的には、ネットワークの出力層から入力層に向かって誤差を逆方向に伝播させ、各層の重みについて損失関数の勾配(微分)を計算します。その後、計算した勾配を用いて重みを更新します。これによりネットワークが学習し、予測精度を向上させます。

問2. ニューラルネットワークの学習で、誤差伝播法が計算するのはどれか?

答え: 3.損失関数の勾配

解説:

誤差伝播法では、ネットワークの出力層で得られた誤差を逆方向に伝播させ、その誤差を各層の重みごとに分けて計算します。この過程で計算されるのが、損失関数の勾配です。損失関数の勾配は、各パラメータ(重み)が損失に与える影響の大きさを示し、それを元に重みを更新します。この更新方法が、ニューラルネットワークの学習の中心です。

問3. 深層学習で層を増やす主なメリットは何か?

答え: 2.特徴を自動的に抽出し、より複雑なパターンを学習できる

解説:

深層学習では、ネットワークの層を深くすることで、より複雑なデータパターンを学習できるようになります。初期の層は簡単な特徴(例えば、エッジや角度など)を学習し、後の層ではこれらの特徴を組み合わせてより高度な特徴(例えば、顔や物体の形など)を学習します。このように層を増やすことで、ネットワークはデータの抽象度を高め、非常に複雑なパターンを捉えることができます。

問4. 誤差伝播法を使う際に、勾配消失問題が起こりやすいのはどの活性化関数か?

答え: 2.シグモイド

解説:

勾配消失問題とは、ニューラルネットワークを学習させる際に、誤差伝播法で計算される勾配が層を遡るごとに非常に小さくなり、最終的には勾配がほぼゼロになる現象です。これが起こると、重みが適切に更新されず、学習が進まなくなります。シグモイド関数は出力が0と1の間に収束するため、大きな入力を与えると勾配が非常に小さくなり、勾配消失が起こりやすくなります。これを避けるために、ReLU(Rectified Linear Unit)などの活性化関数がよく使われます。

問5. ニューラルネットワークの重みを更新する際、使用する最適化アルゴリズムとして誤差伝播法とともに用いられるのはどれか?

答え: 3.確率的勾配降下法(SGD)

解説:

誤差伝播法で計算した勾配を用いて、重みを更新する方法として**確率的勾配降下法(SGD)**がよく使われます。SGDは、全てのデータを使うのではなく、ランダムに選ばれた一部のデータ(ミニバッチ)を使って重みを更新する手法です。これにより、計算効率が良くなり、学習が早く進むといったメリットがあります。SGD以外にも、モーメンタムやAdamなど、より効率的な最適化アルゴリズムが存在しますが、誤差伝播法と最も基本的に組み合わせて使われるのはSGDです。

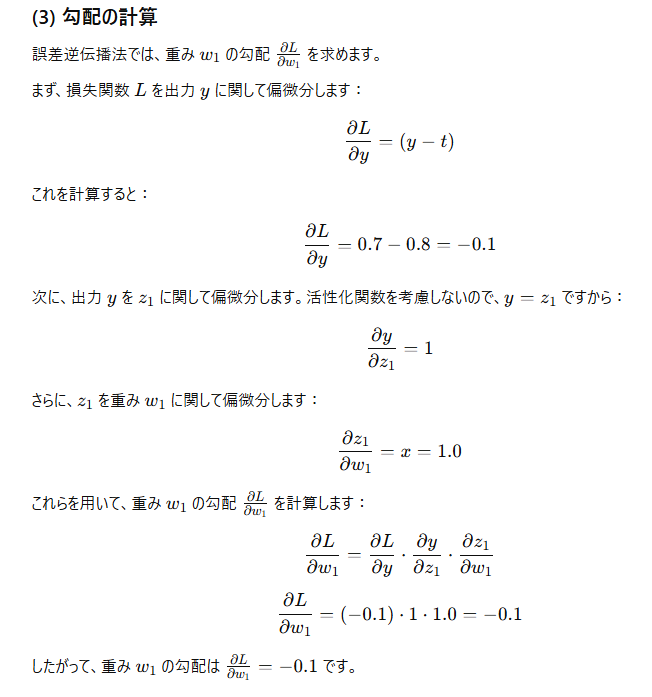

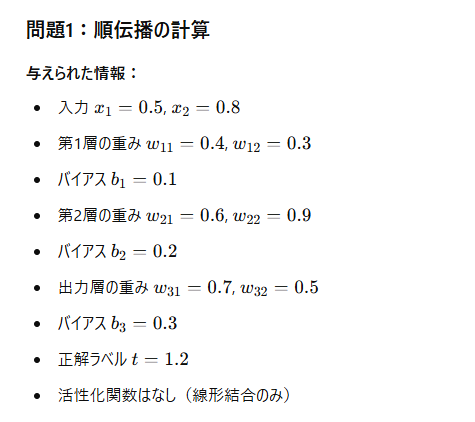

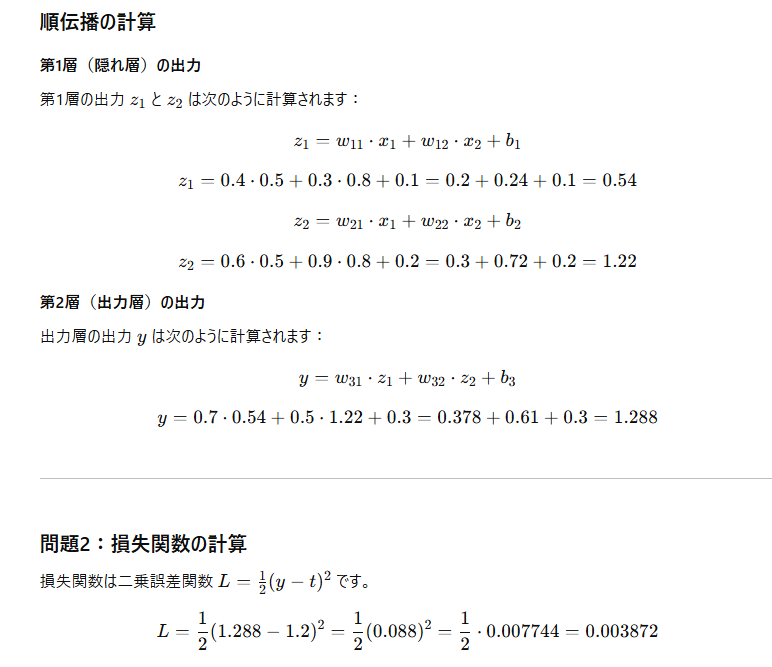

問6.

問7.

参考資料

・データサイエンス数学ストラテジスト[上級]公式テキスト | 公益財団法人 日本数学検定協会 |本 | 通販 | Amazon