今回は信号によってデータを伝える手法に関する内容となります。

パーセプトロン

パーセプトロン(Perceptron)は、ニューラルネットワークの基本単位であり、人工ニューロンと呼ばれることもある。1958年にフランク・ローゼンブラットによって提案された。

(1)パーセプトロンの構造

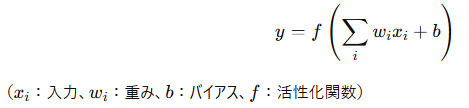

パーセプトロンは、以下の要素で構成される:

- 入力層(複数の特徴量)

- 重み(Weight)(各入力の重要度を表す)

- バイアス(Bias)(調整パラメータ)

- 活性化関数(Activation Function)(しきい値を超えたら出力する)

- 出力(Output)(0 または 1)

(2)パーセプトロンの特徴

- 単純な線形分類が可能(例:AND や OR)

- 重みとバイアスを調整しながら学習する(学習アルゴリズム:パーセプトロン学習則)

- 単層パーセプトロンではXOR問題を解けない(線形分離できない問題)

ニューラルネットワーク

ニューラルネットワーク(Neural Network)は、パーセプトロンを多層にしたもので、より複雑な問題を解決できるようにした人工知能のモデルです。

(1)ニューラルネットワークの構造

ニューラルネットワークは以下の3つの層で構成されます:

- 入力層(Input Layer):データを入力する層

- 中間層(隠れ層, Hidden Layer):重みと活性化関数を通じて特徴を抽出

- 出力層(Output Layer):最終的な予測結果を出す

(2)パーセプトロンとの違い

| 比較項目 | パーセプトロン | ニューラルネットワーク |

|---|---|---|

| 層の数 | 1層(単層) | 複数層(多層) |

| 学習できる問題 | 線形分離可能な問題(AND, OR) | 非線形問題(XOR, 画像認識など) |

| 活性化関数 | ステップ関数(0 or 1) | シグモイド, ReLU, ソフトマックス など |

| 代表的な応用 | 基本的な分類問題 | 画像認識, 音声認識, 自然言語処理 など |

(3)多層ニューラルネットワーク(MLP: Multi-Layer Perceptron)

多層パーセプトロン(MLP)は、隠れ層を増やすことでXOR問題などの非線形問題も解決できる。活性化関数にはシグモイド関数やReLU関数が使われ、勾配降下法や誤差逆伝播法(バックプロパゲーション)によって学習が行われる。

まとめ

・パーセプトロンは、単純な線形分類を行うモデルだが、XOR問題は解けない。

・ニューラルネットワークは、パーセプトロンを多層化し、非線形問題を解決できるようにしたモデル。

・ 多層ニューラルネットワーク(MLP)によって、画像認識・音声認識・自然言語処理など幅広い分野で活用されている。

演習

問1

パーセプトロンの基本的な構成要素として含まれないものはどれか?

- 重み(Weight)

- バイアス(Bias)

- 活性化関数(Activation Function)

- 隠れ層(Hidden Layer)

問2

単層パーセプトロンでは解くことができない問題として正しいものはどれか?

- ANDゲート

- ORゲート

- XORゲート

- 単純な線形回帰

問3

ニューラルネットワークがパーセプトロンよりも複雑な問題を解決できる理由として適切なものを選べ。

- 活性化関数を使用せずに計算を行うから

- 隠れ層(Hidden Layer)を持ち、非線形変換が可能だから

- 重みを固定し、学習せずに計算するから

- 入力層の数を増やすことで精度が上がるから

問4

ニューラルネットワークの学習方法として広く用いられる手法はどれか?

- パーセプトロン学習則

- ニュートン法

- バックプロパゲーション(誤差逆伝播法)

- 遺伝的アルゴリズム

問5

次のうち、多層ニューラルネットワーク(MLP)に関する説明として誤っているものはどれか?

1.活性化関数にはReLUやシグモイド関数が用いられる。

2.隠れ層を増やすことで、より複雑な特徴を学習できる。

3.出力層の活性化関数は、どのような問題でもReLUが最適である。

4.誤差を最小化するために勾配降下法を利用する。

↓

↓

↓

(解答)

問1 解答:4(隠れ層)

解説:

パーセプトロンの基本的な構成要素には、入力層、重み、バイアス、活性化関数、出力層がありますが、隠れ層(Hidden Layer)は含まれない。隠れ層を持つのは多層ニューラルネットワークである。

問2 解答:3(XORゲート)

解説:

単層パーセプトロンは、線形分離可能な問題(ANDやORゲート)を解くことはできますが、XORゲートのような非線形な問題は解けない。これは、XORが単純な直線では分離できないため、多層構造が必要になるからである。

問3 解答:2(隠れ層を持ち、非線形変換が可能だから)

解説:

ニューラルネットワークは、隠れ層(Hidden Layer)を持ち、活性化関数を用いることで非線形変換が可能になる。これにより、複雑なパターンを学習できるようになる。

問4 解答:3(バックプロパゲーション(誤差逆伝播法))

解説:

ニューラルネットワークの学習には、バックプロパゲーション(誤差逆伝播法)が一般的に使用される。この手法では、出力の誤差を計算し、それを入力層に向かって逆伝播させながら重みを調整する。

問5 解答:3(出力層の活性化関数は、どのような問題でもReLUが最適である)

解説:

出力層の活性化関数は、問題の種類によって適切なものを選ぶ必要があります。例えば:

- 分類問題 → ソフトマックス関数

- 回帰問題 → 恒等関数(またはシグモイド関数)

- 隠れ層 → ReLU(Rectified Linear Unit)が一般的

「どのような問題でもReLUが最適である」というのは誤り。

参考資料

・データサイエンス数学ストラテジスト[上級]公式テキスト | 公益財団法人 日本数学検定協会 |本 | 通販 | Amazon